جفری هینتون، که به او "پدرخوانده هوش مصنوعی" میگویند، از مزایای هوش مصنوعی استقبال میکند، اما همزمان نگرانیهایی درباره پتانسیل مخاطرات آن بیان میکند. او به مواردی مانند روباتهای جنگ خودمختار، اخبار جعلی و تبعیض ناخواسته در استخدام و پلیس اشاره میکند. جفری هینتون، که دانشمند کامپیوتر و روانشناس شناختی بریتانیایی است، به ویژه به دلیل کارهایش در زمینه شبکههای عصبی مصنوعی که اساس هوش مصنوعی را تشکیل میدهند، شناخته میشود. وی قبل از ترک گوگل در ماه مه سال جاری، به مدت یک دهه برای این شرکت کار کرد و نگرانیهای خود را درباره خطرات هوش مصنوعی بیان کرد.

در مصاحبه با اسکات پلی، مجری برنامه 60 دقیقه، هینتون به جزئیات بیشتری درباره آینده هوش مصنوعی پرداخت.

پس از برجسته کردن آخرین نگرانیها درباره هوش مصنوعی در این مصاحبه، پلی پرسش و پاسخ را با هینتون آغاز کرد و از او پرسید که آیا بشریت میفهمد که این فناوری چگونه کار میکند؟

هینتون پاسخ داد: "نه. من فکر میکنم که ما وارد دورهای میشویم که برای اولین بار، چیزهایی با هوشتر از ما داریم."

هینتون با بیان اینکه معتقد است پیشرفتهای هوش مصنوعی باعث شدهاند که سیستمهای پیچیدهتری میتوانند درک کنند، تصمیمگیری کنند و به صورت هوش مصنوعی عمل کنند، این مسئله را بیان کرد. وقتی از هینتون پرسیده شد که آیا این سیستمهای هوش مصنوعی هوشیار هستند، هینتون گفت که به دلیل عدم وجود خودآگاهی در حال حاضر، احتمالاً این طور نیستند، اما در آینده "به موقع" ممکن است هوشمند تر شوند. او همچنین با نظر پلی موافقت کرد که به عبارت دیگر، انسانها به عنوان دومین موجود باهوش در زمینه پیدایش هوش مصنوعی مطرح خواهند بود.

پس از اینکه ایده مطرح شد که سیستمهای هوش مصنوعی ممکن است در یادگیری بهتر از ذهن انسان عمل کنند، پلی به این فکر افتاد که چگونه، به عنوان یک فناوری توسط انسانها طراحی شدهاند - تصوری که هینتون آن را تصحیح کرد.

"نه، اینطور نیست. کاری که ما انجام دادیم این بود که الگوریتمهای یادگیری را طراحی کردیم." هینتون گفت: "این کار کمی شبیه به تکامل است. اما زمانی که این الگوریتمهای یادگیری با دادهها تعامل میکنند، شبکههای عصبی پیچیدهتری ایجاد میکنند که در انجام کارها بهتر عمل میکنند. اما واقعاً نمیدانیم که آنها چگونه این کارها را انجام میدهند."

هینتون به برخی از مزایای عظیم هوش مصنوعی در زمینه مراقبتهای بهداشتی اشاره کرد، از جمله توانایی آن در تشخیص و تفسیر تصاویر پزشکی و طراحی داروها. این یکی از دلایل اصلی است که هینتون به تأثیرات مثبت هوش مصنوعی با نگاهی مثبت نگرانیها نگاه میکند.

اما هینتون در مورد نحوه آموزش سیستمهای هوش مصنوعی توضیح داد: "ما ایده بسیار خوبی داریم که تقریباً چه کاری انجام میدهد. اما به محض اینکه واقعاً پیچیده شود، ما در واقع نمیدانیم چه اتفاقی در حال رخ دادن است، بیشتر از آنچه در مغز شما میگذرد."

این احساس تنها نمونهای از نگرانیهای پیرامون هوش مصنوعی بود و به خطری بزرگ اشاره کرد که با هوشمندتر شدن سیستمها ممکن است به وجود آید. یکی از راههایی که این سیستمها ممکن است از کنترل خارج شوند، نوشتن کد رایانهای خودشان برای اصلاح خودشان است. و این چیزی است که باید به طور جدی نگران آن باشیم."

هینتون افزود که به علت اطلاعات بیشتری که هوش مصنوعی از مسائلی مانند آثار داستانی معروف، چرخههای رسانهای انتخاباتی و سایر موارد مشابه دریافت میکند، هوش مصنوعی در دستکاری اطلاعات و تأثیرگذاری بر رفتار افراد بهبود مییابد. هینتون گفت: "فکر میکنم ظرف پنج سال آینده بهتر از ما در تأمل و استدلال خواهد بود."

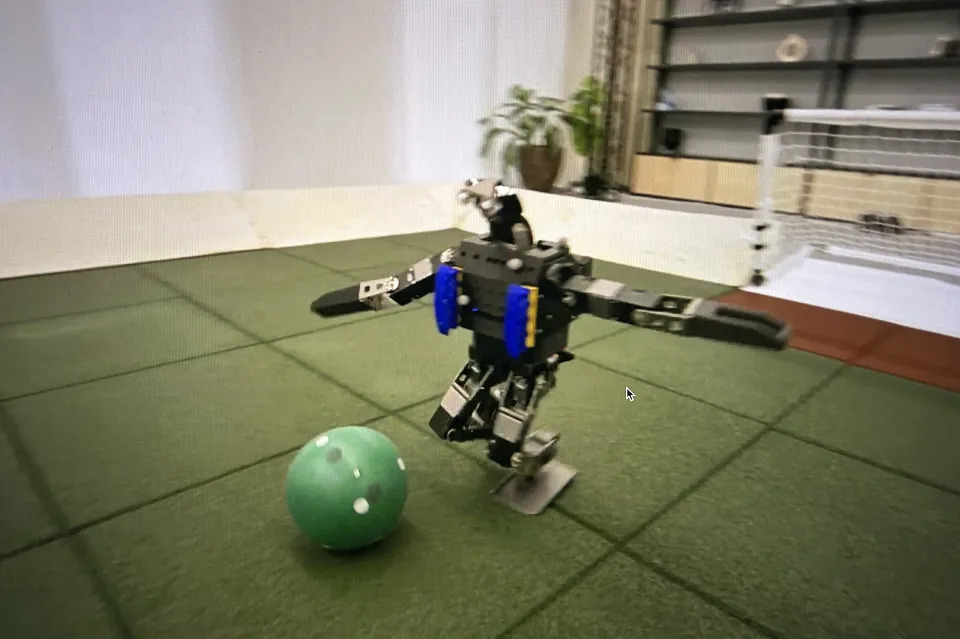

در آخر، هینتون اشاره کرد که خطراتی مانند روباتهای میدان جنگ خودمختار، اخبار جعلی و سوگیری ناخواسته در استخدام و پلیس وجود دارد. او همچنین تأکید کرد که "داشتن یک طبقهای از افراد بیکار که برای آنها ارزش زیادی ندارند، زیرا کارهایی که قبلاً انجام میدادند اکنون توسط ماشینها انجام میشود" نیز یکی از چالشهای مهم هوش مصنوعی است.

او گفت: "ما وارد دورهای از عدم قطعیت بزرگ میشویم که با مسائلی سر و کار داریم که قبلاً انجام ندادهایم. و به طور معمول در اولین باری که با چیزی کاملاً نو روبرو میشوید، اشتباه میکنید. و ما نمیتوانیم این کار را با این مسائل اشتباه کنیم."

زمانی که پلی از هینتون خواست که آیا این به معنای این است که هوش مصنوعی در آینده ممکن است بشریت را تسخیر کند، هینتون گفت: "بله، این یک امکان است. من دارم نمیگویم اتفاق خواهد افتاد. اگر میتوانستیم جلوی این راه را به آنها بگیریم، عالی میشد. اما واضح نیست که آیا میتوانیم جلوی این راه را به آنها بگیریم یا نه."

پس چه باید کرد؟

هینتون گفت که این ممکن است یک نقطه عطف باشد، جایی که بشریت ممکن است با تصمیمی مواجه شود که آیا باید این مسائل را به طور جدی تر توسعه دهد و چگونه مردم باید "خودشان را محافظت کنند" اگر این کار را بکنند.

هینتون گفت: "فکر میکنم پیام اصلی من این است که عدم قطعیت بزرگی در مورد اتفاقات آینده وجود دارد." او افزود: "این مسائل میفهمند و به علت مفهوم آنها، ما باید به دقت در مورد آینده فکر کنیم و ما واقعاً نمیدانیم."

پلی گزارش کرد که هینتون گفته است که از کاری که انجام داده و با توجه به پتانسیل هوش مصنوعی برای خیر، اندیشهای ندارد، اما اکنون زمان آن رسیده تا بیشتر آزمایشها در مورد آن انجام داده شود تا درک بهتری از آن داشته باشیم، مقررات خاصی را اعمال کرده و یک تفاهمنامه جهانی برای ممنوعیت استفاده از روباتهای نظامی امضا شود.